音楽分野の情報教育

デジタル音声信号処理技術を用いたコンピュータ音楽教育

莱 孝之(国立音楽大学音楽学部音楽デザイン学科助教授)

1. はじめに

音楽教育にもデジタル・シンセサイザー、シーケンサー・ソフト、記譜アプリケーションなど様々なコンピュータ技術が導入されている。筆者が初めてコンピュータ音楽に触れた1980年当時、コンピュータを用いて音楽、特にデジタル音声信号処理技術を利用することは、科学者の世界でしかなかった。当時、コンピュータ音合成や信号処理を試みるにはマクロ・アセンブラを駆使しなくてはならず、DSP専用コンピュータのためには複雑なマイクロコード・プログラミングすら要求された。ひとつのコンピュータ音楽作品を制作するのにプログラミングだけで1年近い歳月を要した時代、コンピュータ音楽は一般の音楽教育とは全く無縁であった。

1980年代中頃になると、MIDI機器やパソコンの登場によりコンピュータで音符を操ることが容易になる。しかし、実時間音声信号処理技術を用いて音楽を実現しようとする音楽家はごく稀であり、パリのIRCAMやオランダのソノロジーなど、特定の研究所でほんの一握りの学生が信号処理技術を応用した音楽制作を学んでいただけである。

ところが、1991年に登場した実時間音声信号処理専用DSPボード「IRCAMシグナル・プロセシング・ワークステーション(ISPW)」と、ミラー・パケット氏(元IRCAM、現UCSD)が開発した、GUI環境でのオブジェクト指向プログラミングを実現する音楽アプリケーション「Max」により、実時間音声信号処理技術を利用することが著しく容易になった。さらに最近では、パソコンでの実時間信号処理も可能になり、コンピュータ音楽教育も新たな展開を迎えようとしている。

2.Max

ISPW用Maxには様々な機能を持つオブジェクトが用意されており、さらにライブラリーも提供されている。これらのオブジェクトはMIDIデータを主に扱うコントロール・オブジェクトと信号処理のためのシグナル・オブジェクトの二つに分類することができる。コントロール・オブジェクトには四則演算や論理演算などの通常の演算オブジェクトの他、MIDI入出力を扱うオブジェクトなどが用意されている。また、自動伴奏等に用いられる、パターン認識を応用したスコア・フォローイング機能も備わっている。

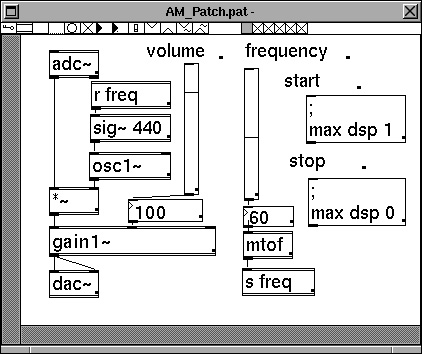

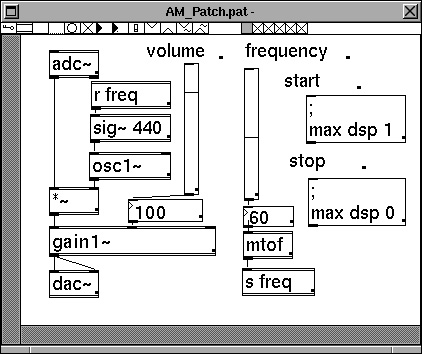

一方、シグナル・オブジェクトにはADC/DAC、サイン波等を発生させるオシレータ、サンプリング用オブジェクト、そしてFFTを実時間で実行するオブジェクト等が用意されている。これらのオブジェクトへのデータ入出力はパッチ(Patch)と呼ばれるプログラミング・ウィンドウ内でマウスをドラッグして線をひくことによって実現される。

3.Maxを使ったコンピュータ音楽教育

国立音楽大学音楽デザイン学科では1991年より、ISPW用MAXを使用してコンピュータ音楽の授業を行っている。さらに数年前より、他学科の学生にもMAXを学習する機会が設けられている。以下、MAX基礎クラスでの授業進行を記す。

(1)コントロール・オブジェクトの実習

コントロール・オブジェクトの学習は、コンピュータのMIDI入出力にシンセサイザーを接続した環境から始める。まず、シンセサイザーの演奏をMAXのパッチ内に取り込み、入力MIDIデータを数値で確認する。次に、コンピュータからMIDI出力を使ってシンセサイザーを演奏させるパッチを作成。このMIDI入出力オブジェクトの間に乱数発生オブジェクト等を挿入していき、各オブジェクト機能を学習する。鍵盤演奏やペダルなどの入力とオブジェクト機能、音声出力の関係を体感しながらMaxプログラミング技法を学んでいく。

(2)信号処理オブジェクトの実習

信号処理オブジェクトの実習は、サイン波を発生させ、ピッチや音量を変化させることから始める。この過程でオシロスコープに音波を表示させ、振幅、周期、波形の変化と音の関係を耳と目で体験。さらに、オブジェクトのパラメータ値をリアルタイムに変化させ、音と数値の関係をも把握する。コンピュータ音合成の基本が理解できたなら、引き続きフリークェンシ・モジュレーションなどの音合成技術を学習していく。

|

| 図1 Maxパッチ例:アンプリチュード・モジュレーション |

一方、ADCを介して入力された音声信号が数値化されていることをパッチ内で確認し、実時間音声信号処理へと進む。入力信号にサイン波を乗算することによって実現されるアンプリチュード・モジュレーション(パッチ例参照)や、ディレー、フィードバック、ピッチシフトといった標準的な信号処理パッチを作成。さらに、入力信号をメモリーにサンプルし、逆再生や再生時間を変化させることなどを試みる。

(3)より複雑な機能の学習

さらに高度な信号処理技術を収得、応用していくためには、パッチ例の解析から始めるのが良いであろう。例えば、グラフィック・イコライザーというパッチではFFTとiFFTが用いられている。この複雑なパッチを分解し、FFTとiFFTに関し若干解説した後、入力音を一旦FFT解析し、即座にiFFTで音を再構成するパッチを作らせる。ここから、スペクトラム分析やクロス・シンセサイスなど、より高度な信号処理技術へと導いていくことができる。

(4)作品創作への応用

自動演奏を行うパッチをいくつか作成し、学生各自がMaxプログラミングに慣れてきたら、作品創作への応用を試みる。Maxを最も有効に利用する作品形態は、ライブ環境で楽器音に実時間信号処理を施していくコンピュータ音楽作品の実現である。創作学習の手順は、まず使用する楽器音を素材に様々なパッチ、信号処理を実験する。次に楽器演奏パートを作曲し、リハーサルを録音。この録音素材をもとに作品のためのパッチを組み立てていき、最終的にはリハーサルで録音と生演奏との差異を修正する。この過程で、時間進行とともに信号処理プログラムを順次変化させていくテクニックを身につけていく。

この応用段階では学生のプログラミング理解度を見極めつつ、作品へのコンピュータ技術の導入が各学生の音楽的独創性を発展させていくように方向付けしていかなくてはならない。

4.これからのコンピュータ音楽教育

ここで紹介したコンピュータ音楽教育を特殊な事例と考えられる方も多いかと思う。しかし、Macintoshコンピュータ用Maxのためのプラグイン・ソフト「MSP」の登場により、パソコンでの実時間音声信号処理技術の応用、プログラミングの一般化がすでに始っている。

さらに、SGI社製コンピュータのためのMaxや、ミラー・パケット氏が現在開発している「Pure Data」というソフトでは三次元グラフィックス・オブジェクトや実時間画像信号処理機能をも組み込んでいくことが可能になっている。音符操作を主としていたコンピュータ音楽教育は、大きな転換期を迎えようとしている。昔、科学者の世界でしかなかったデジタル音声信号処理技術が、音楽教育の一部となる時代が始ろうとしている。

【目次へ戻る】

【バックナンバー 一覧へ戻る】